Illustration : Anne Kerdi est un personnage virtuel qui promeut la Bretagne à travers des photos, des images ou des textes générés par IA. Elle a été imaginée par un Finistérien de 30 ans. Son compte Instagram créé en mars 2023 la présente comme « Intelligence Artificielle Bretonne ».

(Temps de lecture : 46 minutes)

Depuis la mi-2022 et la sortie grand public de Midjourney (juillet), et surtout de chatGPT d’OpenAI (novembre), les IA génératives ( intelligences artificielles ) occupent une place prépondérante dans l’actualité IT (Information Technology) et font même des incursions dans l’actualité grand public.

- France Culture – ChatGPT, Midjourney : pourquoi les experts de l’IA appellent à ralentir

- Arte – ChatGPT est-il dangereux ?

- France 24 – Est-il trop tard pour réguler l’IA ?

- Tech & Co – Doit-on avoir peur de l’accélération de l’IA ?

Au sommaire :

- Trois définitions

- 1- La différence avec Deep Blue et AlphaGo

- 1.1- IA spécialisées…

- 1.2- … vs IA génératives

- 2- Intelligence artificielle et emploi

- 3- Le problème des fuites de données des IA génératives

- 4- Faut-il ralentir sur l’IA ?

- 5- La théorie de la destruction créatrice de Joseph Schumpeter

- 6- Le cas du développement d’applications

- 6.1- Expériences de dev confirmés avec les IA

- 6.2- Un développeur junior doit-il utiliser de l’IA ?

- 6.3- L’IA, un outil de productivité dans le métier de développeur

- 6.4- La variété des usages des IA par les codeurs

- 6.5- Cursor, l’IDE orienté IA

- 6.6- D’autres outils prometteurs

- 6.7- Le métier de développeur va-t-il disparaître ?

- 6.8- Un bilan après un an et demi d’utilisation des IA pour le code

- Aller plus loin

- Lisez aussi

Trois définitions

- L’intelligence artificielle (IA) est un processus d’imitation de l’intelligence humaine qui repose sur la création et l’application d’algorithmes exécutés dans un environnement informatique dynamique. Pour se rapprocher le plus possible du comportement humain, l’intelligence artificielle a besoin d’une quantité de données et d’une capacité de traitement élevées. Les systèmes de reconnaissance faciale reposent sur des IA.

- L’intelligence artificielle générative ou GenAI (Generative AI) est un type de système d’intelligence artificielle capable de générer du texte, des images ou d’autres médias en réponse à des invites (ou prompts en anglais). L’IA générative peut être unimodale ou multimodale ; les systèmes unimodaux n’acceptent qu’un seul type d’entrée (par exemple, du texte), tandis que les systèmes multimodaux peuvent accepter plusieurs types d’entrée (par exemple, du texte et des images). Midjourney est une IA générative.

- L’intelligence artificielle conversationnelle repose sur le Machine Learning et le traitement du langage naturel pour recueillir et analyser les langages, les comprendre, puis simuler des réponses humaines. Comme elle génère du texte, un IA conversationnelle est un type de GenAI. C’est le cas de chatGPT.

1- La différence avec Deep Blue et AlphaGo

1.1- IA spécialisées…

Jusqu’alors, Intelligences Artificielles et Big data ne marchaient main dans la main que pour améliorer des services sur les grandes plateformes d’internet, sans forcément que le grand public en ait conscience (comme le célèbre algorithme de recommandation de Netflix). Plus confidentielles, il existe également de nombreuses IA spécialisées dans des domaines très particuliers devant gérer de grandes quantités de données :

- logistique / gestion des stocks, industrie (4.0),

- médecine,

- biologie,

- astronomie,

- droit (legaltechs),

- finance (fintech)…

Toutes ces Intelligences Artificielles, ne savent faire qu’une chose, exactement comme Deep Blue qui ne savait que jouer aux échecs, ou AlphaGo qu’au jeu de go, et qui ont battu les champions humains respectivement en 1997 et 2017.

1.2- … vs IA génératives

Généralistes

A contrario, les IA génératives d’aujourd’hui n’ont pas une spécialité particulière, et peuvent être utilisées dans quantités de domaines indifféremment :

- médecine,

- droit,

- cuisine / restauration,

- journalisme,

- ressources humaines

- ou encore cinéma (cf la grève des scénaristes bientôt rejoints par les acteurs),

- etc.

Multimodales

De plus, elles peuvent générer non seulement du texte, mais aussi des images et bientôt des vidéos et du son. Elles commencent aussi à être branchées sur d’autres IA, capables de générer de la voix :

- Une IA générative a été adjointe à l’enceinte connectée Alexa d’Amazon, ce qui permettra de faire un peu plus que simplement fermer des volets et écouter de la musique. Idem du côté de l’assistant vocal Google Assistant, qui intègre Bard.

- La dernière mise à jour de ChatGPT lui donne des yeux et des oreilles, et il peut répondre avec une voix

- AI Dubbing peut traduire un document audio tout en préservant la voix de l’orateur – Zdnet

- HeyGen est capable de faire parler plusieurs langues à n’importe qui, avec conservation du timbre de voix et synchronisation labiale de la vidéo :

Impactantes

Par conséquent, un grand nombre de professions non directement concernées par les big data est susceptible d’être impacté par les IA conversationnelles… même celle de développeur informatique !

En effet, dans une étude de Microsoft menée en février et mars 2023,

- 31 % des chefs d’entreprise ont déclaré qu’ils considéraient l’augmentation de la productivité des employés comme ce qu’ils apprécieraient le plus dans l’IA sur le lieu de travail.

- 29% ont mentionné aider les employés avec des tâches nécessaires mais répétitives/banales,

- et 25% ont déclaré éliminer le temps passé par les employés sur des activités à faible valeur.

- 16% ont déclaré réduire leurs effectifs.

2- Intelligence artificielle et emploi

Passé le premier effet Waouh des prouesses des deux outils, puis les poncifs sur la triche à l’école, certains médias se sont inquiétés des implications des Intelligences Artificielles sur le futur, en premier lieu sur les fake news de haute volée (deep fakes), mais aussi plus largement sur l’emploi.

2.1- 300 millions d’emplois remplacés par l’IA ?

- IBM avait annoncé en début d’année le licenciement de 5000 salariés, auquel s’ajoute un gel des recrutements en RH sur 7800 postes sur des tâches pouvant être réalisées par les Intelligences Artificielles. Le groupe a néanmoins embauché 7000 développeurs et commerciaux au premier trimestre. Il compte un total de 260.000 salariés.

- Selon le patron de Springer, l’automatisation de la production d’articles grâce à l’intelligence artificielle va révolutionner le journalisme, qu’elle va pouvoir «soutenir» ou même «remplacer».

- Le géant britannique des télécommunications BT Group a annoncé en dernier lieu qu’il supprimait 55 000 emplois et que l’IA pourrait en remplacer 10 000 d’ici 2030.

- La banque d’affaires Goldman Sachs explique que les IA génératives pourraient faire disparaître 300 millions d’emplois dans le monde dans un futur proche. (En même temps ils n’ont pas vu venir la crise de 2008 et encensaient Madoff et les subprimes encore peu de temps avant la faillite de Lehman Brothers.)

- « The Future of Employment » des chercheurs Michael Osborne et Carl Benedikt Frey publié en 2013 avait fait grand bruit : il déterminait que 47 % des emplois aux États-Unis étaient susceptibles d’être remplacés avant 2025 par l’automatisation. Des proportions similaires étaient mentionnées pour la France.

2.2- L’impact sur le recrutement des juniors

52 % des employeurs sondés jugent plus simple et économique de former une IA que de recruter un jeune diplômé. Ce sentiment est plus exacerbé dans la finance (70%) que dans l’éducation (40%) ou le commerce, la restauration et les loisirs (39%).

A vouloir maximiser l’efficacité via l’IA, les employeurs se heurtent à un revers de la médaille : ils voient la technologie comme substitut de plus en plus évident à certaines tâches et métiers. employeur sur 2 juge plus simple de former une IA que de recruter un jeune diplômé

</EDIT>

3- Le problème des fuites de données des IA génératives

Les médias mainstream s’en sont moins fait l’écho, mais il faut aussi se méfier des données qu’on envoie à chatGPT et aux autres IA.

3.1- Les fuites

ChatGPT a été temporairement bloqué pour les questions de données personnelle en Italie (RGPD). C’était fondé quand on voit la mésaventure de Samsung qui a vu des données confidentielles fuiter dans les réponses que chatGPT a donné… à ses concurrents ! Ensuite cela a été le cas de Bard, dont des conversations d’utilisateurs se sont retrouvées publiées… sur Google. Le moteur de recherche a en effet indexé pendant un certain temps des conversations dont les utilisateurs avaient créé un lien de partage.

Pour remédier à ce problème qui conduit 82% des entreprises à interdire son usage, ChatGPT Plus a ajouté un mode privé. OpenAI a ainsi mis à jour ChatGPT pour inclure l’option de refuser l’enregistrement de l’historique de chat par le chatbot ou l’utilisation des données utilisateur pour l’entraînement du programme (ChatGPT Enterprise). Bing Chat a lui aussi une offre payante avec la même option. Google a de son côté fixé son problème d’indexation.

Qu’en est-il des concurrents ? Copilot, Codeium, Cody, Llama 2 de Meta, Claude… Je n’ai trouvé l’information pour aucun d’entre eux.

3.2- Le vol

De plus, cette limitation d’enregistrement d’OpenAI peut limiter les fuites, mais pas le vol. Ainsi, 100 000 comptes chatGPT ont fuité avec des mots de passe et login, siphonnés par des pirates. Cependant, c’est un peu le risque pour toutes les applications en ligne.

3.3- L’espionnage économique

Enfin, hors fuites et hors piratage, il faut être conscient qu’on confie des données aux sociétés propriétaires des IA, qui peuvent en faire ce qu’elles veulent. Or depuis Edward Snowden, on sait très bien que la NSA peut mettre son nez à peu près partout sur internet. Et côté chinois, les liens entre les BATX et le parti ne sont plus à démontrer non plus.

Pour ces trois raisons, il faut-être très vigilant sur les données qu’on offre sur un plateau aux sociétés d’intelligence artificielles.

▶️ Journal du Net • ChatGPT en entreprise : comment éviter la fuite de données sensibles ?

4- Faut-il ralentir sur l’IA ?

4.1- De graves risques pour la société ?

4.1.1- Une lettre ouverte

La Chine donne un avant-goût de ce qui nous attend avec l’intelligence artificielle :

L’intelligence artificielle pèse en Chine déjà 20 milliards d’euros, un chiffre qui pourrait plus que doubler d’ici deux ans. Pékin ambitionne de dépasser les États-Unis, pour devenir numéro un mondial dans ce domaine, d’ici 2030. Cette technologie, qui simule l’intelligence humaine, est capable de générer des textes, des images, des vidéos et des créations originales dans le domaine de l’art ou du design par exemple. Son arrivée bouleverse le marché du travail et même les relations humaines.

▶️ France 24 • La Chine sous l’emprise de l’intelligence artificielle

« Les systèmes d’IA dotés d’une intelligence capable de concurrencer celle de l’homme posent de graves risques pour la société »,

▶️ Suspendre les expériences géantes d’IA : une lettre ouverte

indique une lettre ouverte publiée en avril 2023 par plus de 1000 signataires liés à l’IA, parmi lesquels Elon Musk, qui a quitté l’aventure OpenAI en 2018 et qui tout en signant cette lettre, en bon roi des trolls, était en train d’acheter de la mémoire vidéo en masse pour monter sa propre IA : pas moins de 10000 GPU ! Ceci dit, les autres experts de l’IA signataires étaient sincères et appelaient vraiment à ralentir.

A défaut de réellement déboucher sur un moratoire, impensable dans un contexte de compétition économique et alors que Google préparait sa riposte avec Bard (aujourd’hui Gemini), cette lettre ouverte a eu le mérite de susciter le débat.

4.1.2- Certaines IA posent question

Car oui, certaines IA posent en effet question dès aujourd’hui, comme le montre Science4All :

- Les IA dans les armes autonomes, c’est un problème ;

- L’IA de désinformation à grande échelle des citoyens en Inde, c’est un problème ;

- L’IA Aladdin de Blackrock qui gère la majeure partie de la finance mondiale, c’est un problème ;

On pourrait ajouter :

- La vidéo surveillance algorithmique et les drones qu’on nous promet pour les JO de Paris, c’est un problème

Mais il ne s’agit pas là d’IA génératives, ce sont d’autres types d’IA. En revanche, qu’une IA générative soit détournée par le gouvernement chinois pour à la fois surveiller et endoctriner sa population, c’est un problème aussi. Il faudrait donc de la régulation. Mais comment réguler les agissements de la Chine, de l’Inde, de Blackrock, des marchands d’armes, des JO ? Pas simple.

▶️ Le Monde • Comment des « travailleurs du clic » ont entraîné, sans le savoir, les IA de vidéosurveillance du Kremlin

4.2- Réguler les IA génératives ?

4.2.1- Un problème de souveraineté

Vers une guerre froide de l’IA ?

Le principal problème que posent les IA conversationnelles, c’est le modèle de société et les valeurs sous-jacentes qu’elles peuvent véhiculer. Cependant c’est la même problématique qu’avec les algorithmes des GAFAM, les séries de Netflix et Disney +, ou les blockbusters hollywoodiens. Demandez à ChatGPT ou aux autres IA US qui a inventé l’aviation ou le cinéma, elles ne parleront ni de Clément Ader, ni des Frères Lumière. Les américains sont bien plus chauvins qu’on ne l’imagine.

Or c’est idem côté chinois. Résultat : demandez comment a démarré la Covid, quel est le statut de Taiwan ou des renseignements sur le massacre de Tian’anmen à une IA américaine et à une IA chinoise : vous aurez des réponses sensiblement différentes !

Dans le même temps, quel modèle avons nous pour promouvoir une vision européenne du monde? Rien, nada, le néant.

▶️ France Culture • Europe, Chine, Etats-Unis face au contrôle de l’intelligence artificielle

▶️ Ludo Salenne • Vers une guerre froide de l’IA ? Analyse géopolitique complète

▶️ France Université Numérique • Une IA souveraine : quelles alternatives à ChatGPT ?

▶️ L’Usine Digitale • Alibaba ajoute, à son tour, de l’IA générative à ses services

▶️ TechCrunch • Baidu va déployer l’IA conversationnelle dans les domaines de la recherche, du divertissement embarqué et bien plus encore

▶️ L’Usine Digitale • La start-up française Mistral AI dévoile Mistral 7B, un grand modèle de langage open source

USA, Chine, Europe

Il existe un adage dans le monde du numérique, lancé par la patronne des patrons italiens (équivalent du MEDEF en France) : « Lorsqu’il y a une innovation,

- les Américains en font un commerce

- les Chinois une copie [ce n’est plus tout à fait vrai : Les super applications chinoises WeChat ou Grab n’ont pas d’équivalent en Occident. Et fort heureusement, la Grande Muraille Numérique et le système de crédit social non plus… pour l’instant du moins]

- les Européens un règlement [RGPD, DMA, DSA, futur AI Act, etc] »

France

Quand-à la France…

« Je plaide donc [pour] que nous nous fixions comme objectif d’avoir un OpenAI européen sous cinq ans, avec les calculateurs, les scientifiques et les algorithmes nécessaires. »

Bruno Le Maire, Ministre de l’Économie, des Finances et de la Souveraineté industrielle et numérique

Poudre aux yeux ?

… On se demande si la French Tech et la startup Nation avec leurs anglicismes omniprésents n’ont pas une part de poudre aux yeux, tant les décideurs français sont à la ramasse sur le numérique (et ce depuis le mulot de Jacques Chirac, en 1996). Les gouvernements successifs ont quand même :

- liquidé Bull (fondu dans ATOS),

- vendu Thomson pour un euro symbolique (à Lagardère après avoir renoncé à Daewoo),

- complètement démantelé Alcatel (avant d’en faire autant avec le reste du groupe Alstom)

- offert toutes les données de santé du pays à Microsoft, décision réitérée en 2024

- freiné des quatre fers pour migrer les administrations vers les logiciels libres

- fait un fiasco de la numérisation des services publics où bugs, plantages et burn-out s’accumulent (CAF, caisse d’assurance vieillesse, services de police, logiciel RH de l’éducation nationale…). Le coûteux recours aux cabinets de conseil, censé pallier une prétendue incompétence des administrations, sert en réalité à leur privatisation rampante

- laissé ATOS se transformer en accident industriel. Le plus grand groupe d’informatique français va être vendu à la découpe

- Laissé les clés des centrales nucléaires françaises à Amazon

- etc.

Pour notre souveraineté numérique, on repassera.

- Le gouvernement lance une expérimentation de l’IA générative dans les services publics – L’Usine Digitale

- Voici le plan d’action de la Cnil pour encadrer l’intelligence artificielle – L’Usine Digitale

Mistral AI

Heureusement que Mistral AI ne se fie pas aux propos du Ministre de la Souveraineté numérique pour son développement.

▶️ France Culture -| Soft Power • Mistral AI, la licorne française de l’Intelligence Artificielle (107 min)

▶️ Melvynx • Mêler les IA dans ses applications : OpenAI, Perplexity, Mixtral

▶️ Infodocbib • Les NPU, des puces à IA

4.2.2- Des biais dès la conception

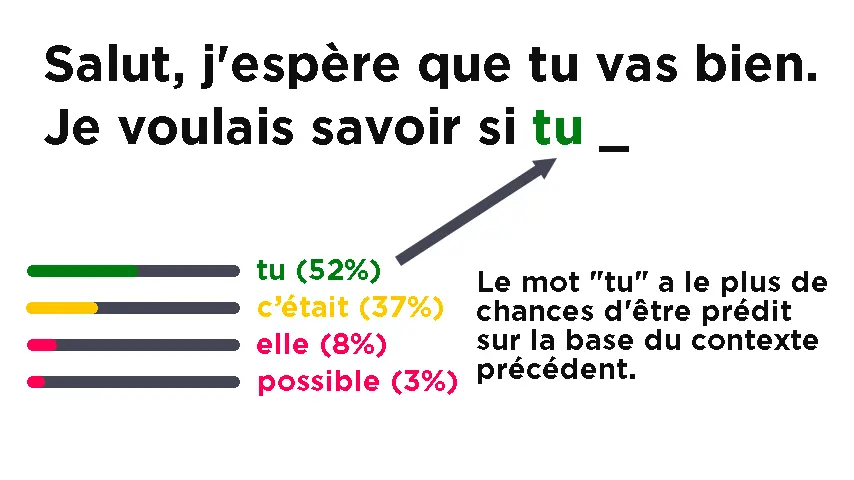

Le job des IA conversationnelles, c’est de prédire le mot suivant le plus probable dans un contexte donné.

Simple, basique : une IA reprend tous les travers du fonds qui a servi à leur apprentissage. La composition de ce fonds est ainsi un 1er biais : on se souvient de Tay, le chatbot de Microsoft en 2016, qui s’est montré raciste, vulgaire et négationniste en seulement 24h de présence sur les réseaux sociaux (Twitter, Snapchat, Kik ou encore GroupMe).

C’est pourquoi l’IA est ensuite retravaillée pour tenir un certain discours et en éviter d’autres (2e biais). De même que la nudité d’une poitrine féminine ne passe pas chez Facebook, certaines choses ne passent pas chez chatGPT.

▶️ France Info • Quand les IA occidentales relaient la propagande russe

4.2.3- Le sort des travailleurs pauvres qui « corrigent » les IA

Ainsi, comme chez Facebook, l’IA est retravaillée par des humains qui doivent étiqueter tous les contenus offensants ou choquants. Ils passent donc toutes leurs journées à regarder attentivement des horreurs, risquant leur santé mentale en plus d’être payés une misère, pour que les utilisateurs finaux n’aient pas à supporter ces horreurs. C’est la face sombre de ChatGPT.

▶️ Blast • Exploitation, destruction et techno-fascisme : la face cachée de l’IA

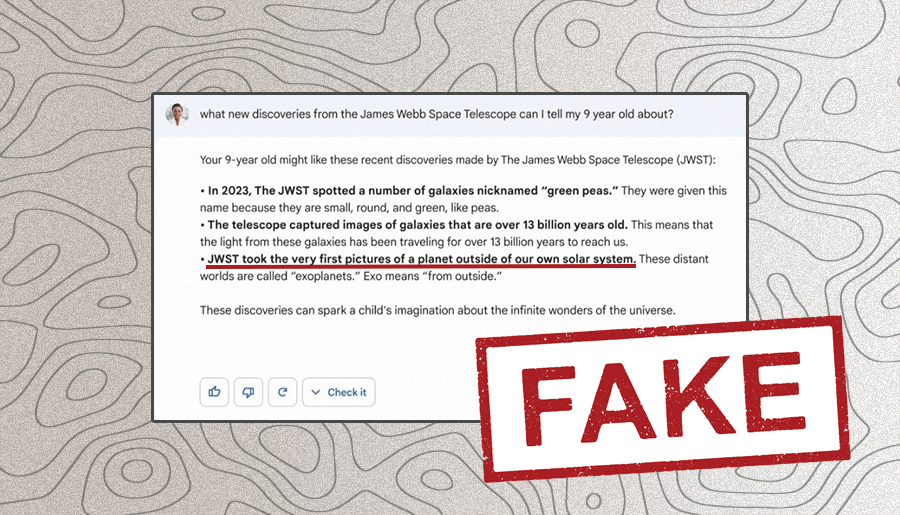

4.2.4- Les hallucinations des IA génératives

D’autre part, les intelligences artificielles génératives ont la fâcheuse habitude de toujours vouloir apporter une réponse, même quand elles n’ont pas les bonnes informations. Ceci a créé un phénomène baptisé « hallucinations », où les chatbots donnent des mauvaises réponses qui semblent parfaitement plausibles. Il y a donc un important travail d’éducation à faire auprès des utilisateurs. Pour éviter de colporter des aberrations, il faut ainsi toujours vérifier que la réponse de notre chatbot favori n’est pas le fruit d’une hallucination.

4.2.5- L’épineuse question des droits d’auteur

Fin 2021, lorsque Microsoft a lancé GitHub Copilot, un assistant payant pour écrire du code, nourri de tout ce qui était sur la plateforme Github (également propriété de Microsoft), des développeurs se sont indignés que leur code mis en ligne en open source, puisse servir à lancer un service payant.

▶️ Clubic • GitHub Copilot : Microsoft poursuivie pour vol de code open-source

L’interrogation s’est ensuite étendue à l’ensemble des fonds qui ont servi à l’apprentissage des IA généralistes (textes, sons, images…) Mais la question est complexe :

D’un côté, il y a la théorie : toute atteinte à un droit de propriété intellectuelle peut être attaquée et critiquée en justice. Mais, de l’autre, il y a la pratique: il est parfois difficile de mettre en œuvre ses droits […] Comment peut-on démontrer que l’IA a violé les droits d’un tiers ?

▶️ L’Usine Digitale • L’IA générative va entraîner des considérations juridiques nouvelles sur le droit d’auteur

La question des droits d’auteur se pose aussi pour les utilisateurs de ces outils. Sont-ils propriétaires de leurs créations ?

Pour l’instant, ces questions juridiques concernant le droit d’auteur vs IA sont en gestation. Plusieurs plaintes ont été déposées, notamment aux Etats-Unis. Lorsque les jugements auront été prononcés, on aura un début de jurisprudence qui nous permettra peut-être d’y voir plus clair.

4.2.6- Le coût énergétique des IA

Enfin, le coût énergétique des IA pose également un vrai problème. Il y a le temps de l’apprentissage pendant quelques mois qui pèse pour 40 % de l’énergie réellement consommée par le modèle d’IA.

Le désormais célèbre modèle d’IA d’OpenAI, GPT-3, aurait à lui seul nécessité quelque 1 287 gigawattheures pour boucler son apprentissage, une consommation comparable à celle de 120 foyers américains sur une année, selon des chercheurs de Google et de l’Université de Berkeley. Soit ce que consomment 110 voitures en un an, ou 502 tonnes d’émissions de carbone.

▶️ Clubic • ChatGPT & co : pourquoi le coût énergétique de l’IA pose un vrai problème

Les 60% restants correspondent ensuite à l’usage en production, quand il faut répondre aux questions des internautes, ce qui consomme beaucoup plus d’énergie qu’une requête sur un moteur de recherche par exemple, ou l’envoi de « mails rigolos« . Or plus le modèle présente de paramètres, plus il fait tourner de GPU, plus il gonfle la consommation d’énergie des data centers et donc in fine la production de gaz à effet de serre. Cependant, il faut aussi garder à l’esprit que les autres usages gourmands du numérique sont les visioconférences en télétravail, le streaming vidéo… Et surtout la fabrication des appareils informatiques !

▶️ L’Esprit Sorcier • L’impact du numérique sur la planète

▶️ Mooc France Université Numérique de l’Inria • Impacts environnementaux du numérique

▶️ Simseo • Microsoft perd 20 $/mois par utilisateur de GitHub Copilot

▶️ Business Standard • ChatGPT coûte 700 000 $ par jour, le fabricant pourrait faire faillite en 2024

Visuel pour un opéra au Munst, à Bruxelles, créé avec Dall-e

4.2.7- Des initiatives internationales pour réguler les intelligences artificielles

Depuis 2021 en UE, un règlement sur l’IA est en négociations dans le but « de mieux réguler les pratiques les plus risquées et de favoriser l’innovation en Europe« . Il est encore trop tôt pour savoir ce qui en sortira.

▶️ L’Usine Digitale • Les Etats-Unis mettent en garde l’Europe sur son projet de réglementation de l’IA

▶️ 01.net • Règlement sur l’IA : pourquoi ça coince encore en Europe ?

L’UNESCO a publié une Recommandation sur l’éthique de l’intelligence artificielle, adoptée la même année par les 193 États membres de l’Organisation (43 pages).

Enfin, le premier sommet consacré à la sécurité sur l’intelligence artificielle (IA) s’est tenu près de Londres, les 1er et 2 novembre 2023. Les dirigeants internationaux se sont entendus sur une déclaration commune, et ont décidé la création d’un équivalent du GIEC pour l’IA :

La Chine, les Etats-Unis, l’UE et une vingtaine d’autres pays ont décidé de collaborer pour veiller à ce que l’intelligence artificielle soit utilisée d’une manière ‘centrée sur l’homme, digne de confiance et responsable’, dans le cadre du premier engagement mondial de ce type.

▶️ Toute l’Europe • L’Union européenne, les Etats-Unis et la Chine signent une première déclaration mondiale sur les risques de l’intelligence artificielle

▶️ L’Express • IA : ce qu’il faut retenir du premier sommet mondial

▶️ L’Express • Sommet mondial sur l’IA : revoilà l’épouvantail « Terminator »

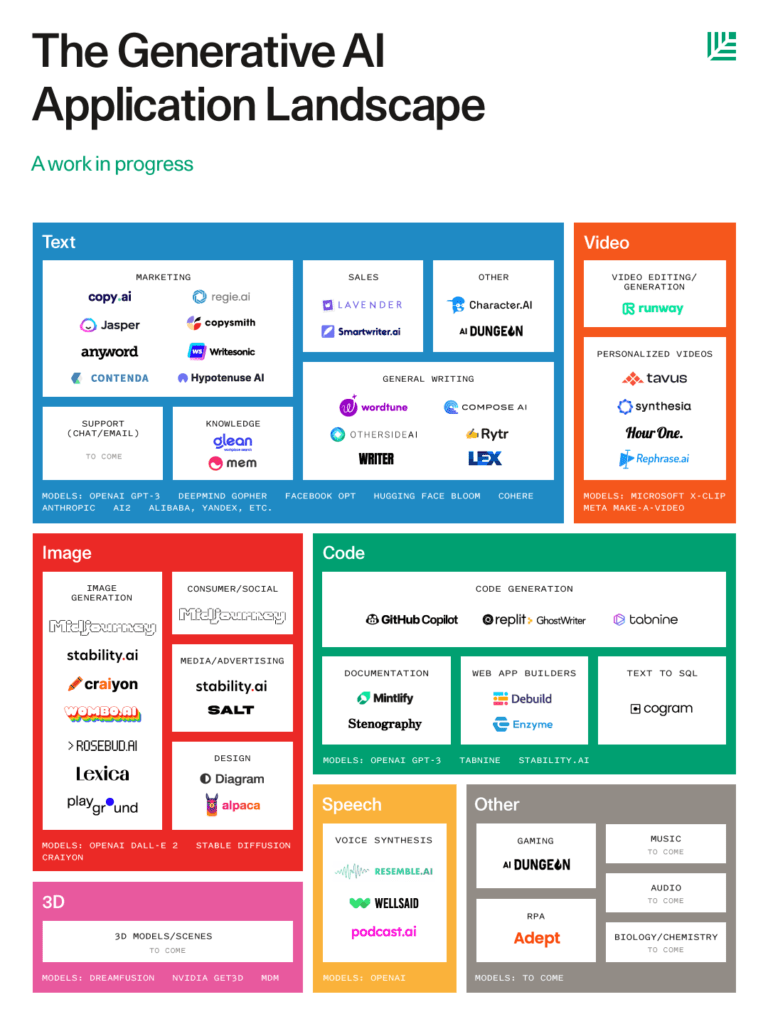

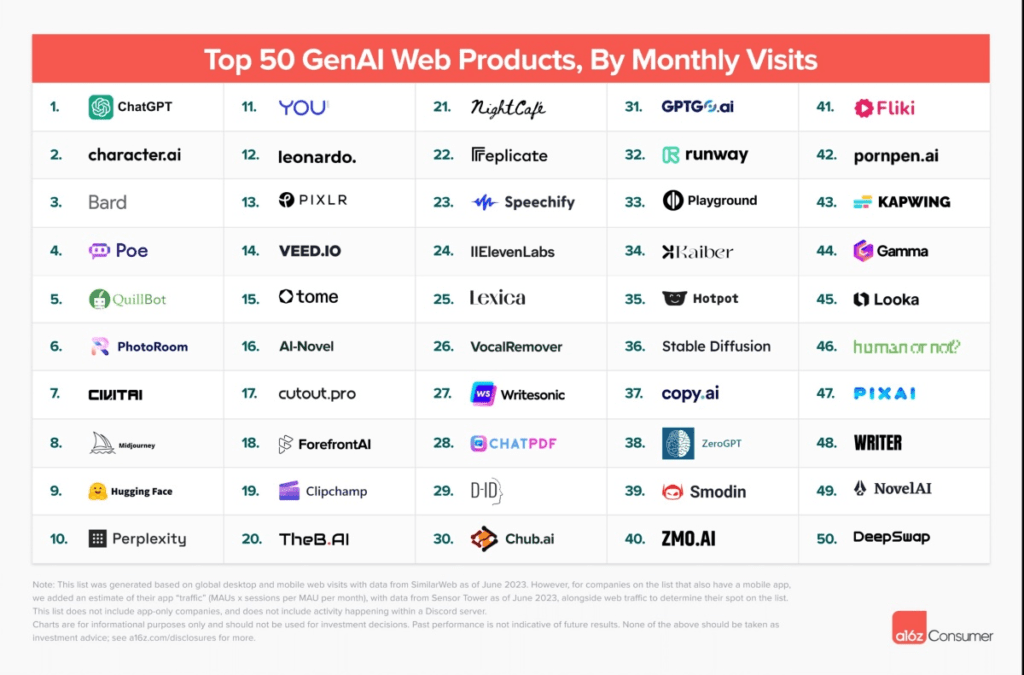

4.3- L’explosion des IA génératives

Pour autant, non seulement les outils d’IA générative se multiplient, mais l’IA se glisse aussi dans les outils qu’on connaît déjà. Quelques exemples parmi d’autres : TikTok, Snapchat, Photoshop, Canva, FlutterFlow, WordPress, Shopify, Spotify, les navigateurs Arc, Brave et Opera, ou encore l’outil No Code Notion, mais aussi tous les outils bureautiques de Microsoft d’une part et de Google d’autre part.

En réalité, avec Search Generative Experience, pas encore disponible en France et plus tard Gemini, c’est même tout l’écosystème de Google qui va être irrigué d’IA. Idem chez Microsoft avec Copilot qui commence à être intégré à Windows 11 (sauf dans l’UE #DMA), et sera au centre de Windows 12.

Sur le web, on trouve des tonnes de vidéos du type Les 14 Outils IA à connaître absolument en 2023. Faut-il vraiment les connaître tous ? Evidemment, non. Comme pour n’importe quel outil, IA ou pas IA, il suffit de savoir que ça existe et de n’utiliser que ceux qui correspondent vraiment à nos besoins.

En tout état de cause, le mouvement semble néanmoins bel et bien irréversible.

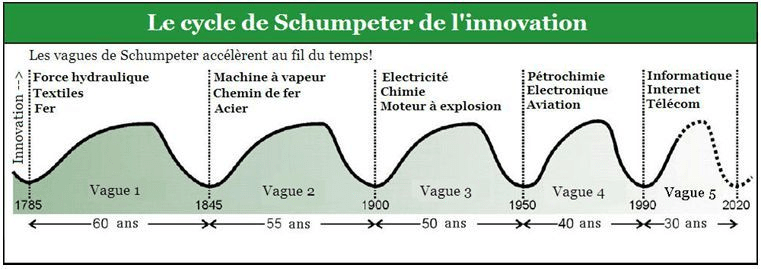

5- La théorie de la destruction créatrice de Joseph Schumpeter

Au delà du grand remplacement de l’humain par une AI générale à long terme, les genAI vont dans l’immédiat provoquer des gains de productivité. Or qui dit gains de productivité dit besoin de moins de personnes pour une même quantité de travail, donc licenciements. Ceux qui resteront en poste vont en faire plus en moins de temps, les autres se retrouveront sur la touche.

5.1- La destruction créatrice

Mais selon la théorie de la destruction créatrice de Joseph Schumpeter, de nouveaux métiers vont émerger en parallèle et donc de nouveaux emplois sur le temps long. Un premier exemple : Prompt Engineer.

Théorisée par Joseph Schumpeter, la destruction créatrice est un processus de disparition d’activités productives obsolètes qui sont remplacées par des activités nouvelles du fait des innovations réalisées par l’entrepreneur innovateur. Celui-ci est une sorte de « capital-risqueur » dont la prise de risques, récompensée par le profit, lui donne un rôle central dans cette dynamique. Les grappes d’innovations, discontinues et interdépendantes, bouleversent les méthodes de production, l’organisation du travail, les spécialisations, les produits et les marchés. Elles révolutionnent l’économie et la société par leurs impacts à la fois destructeurs et créateurs d’activités et d’emplois.

Toutefois [..], l’entrepreneur et le capitalisme sont condamnés en raison du développement de grandes entreprises dirigées par des gestionnaires et non plus par des « entrepreneurs innovateurs ».

Dico de l’éco – Destruction créatrice

Il y a donc deux questions.

- D’une part comment accompagner ceux qui vont garder leur métier pour le faire évoluer,

- d’autre part comment détecter et faire émerger ces nouveaux métiers qui pourraient regonfler le marché de l’emploi.

A terme, selon Schumpeter, tout va s’équilibrer. Oui, mais dans l’intervalle, il va y avoir un moment où les destructions d’emploi liées aux gains de productivité seront plus importantes que les créations induites par les nouveaux métiers. Comment gérer cet intervalle avant l’arrivée du nouvel équilibre?

5.2- L’IA qui cache la forêt

Question subsidiaire : Est-ce que certaines entreprises ne vont pas prendre l’IA comme prétexte pour faire encore plus de profits ? On apprend en effet que les 217 personnes licenciées et remplacées par une IA, évoquées entre autres par Léo TechMaker ci-dessus… l’ont été par un fonds vautour dont la spécialité est d’acheter une entreprise, de la « restructurer » avant de la revendre avec une plus-value. En outre, une partie du personnel a été remplacée par du personnel en Inde. On peut dire ici que c’est l’IA qui cache la forêt !

Il y a alors lieu de se demander si le compte y est vraiment, quand des emplois sont détruits en France, tandis que les nouveaux métiers promis par Schumpeter émergent… en Inde !

6- Le cas du développement d’applications

92% des développeurs basés aux Etats-Unis ont déjà recours à des outils de codage à base d’IA. 70% des répondants à cette même étude estiment que ces solutions leur fournissent un réel avantage.

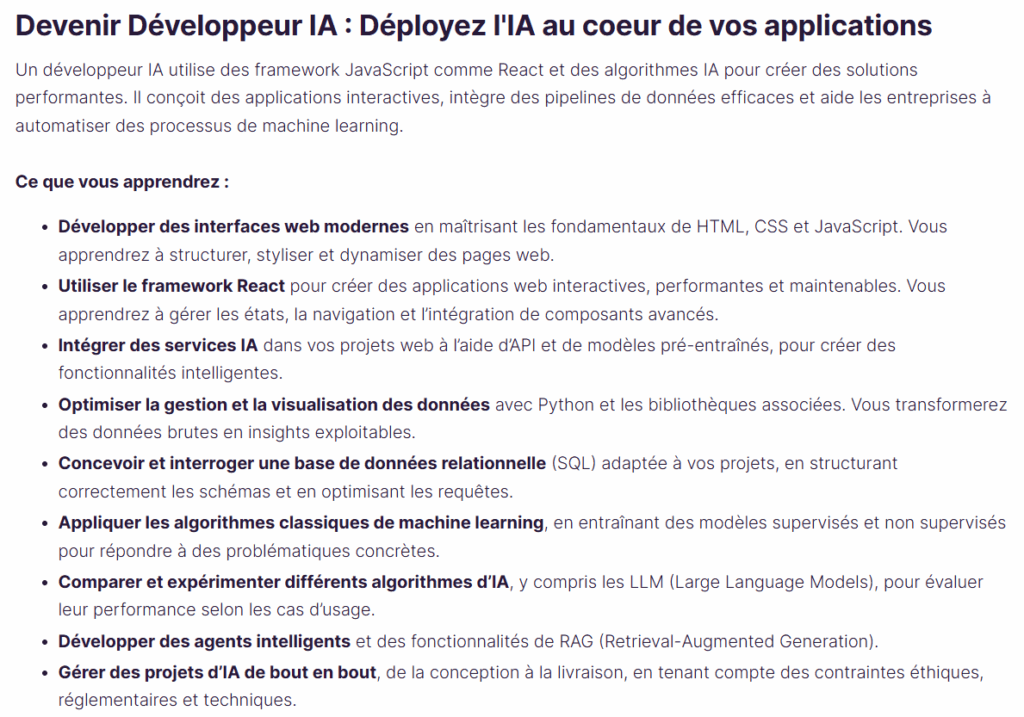

En tant que développeur web je me demande comment mon métier va évoluer alors que je ne suis encore que junior. Comment faire évoluer ma roadmap de formation pour garder mon métier?

6.1- Expériences de dev confirmés avec les IA

Le web pullule de développeurs qui tentent de comparer leurs pratiques avec et sans IA, pour savoir ce qu’il peuvent attendre de ce nouvel outil. Parfaitement Web, Grafikart, Benjamin Code… La plupart concluent qu’il faut être codeur pour poser les bonnes question à l’IA et comprendre ses réponses. En outre, il est souvent plus long et stressant d’ajuster sa demande avec le prompt, que de coder directement soi-même. Enfin, les suggestions de code incessantes peuvent vous déconcentrer.

Parmi les expériences les plus intéressantes, Micode a demandé à trois candidats de créer un QCM en 2 heures.

- Le premier est un développeur web senior connu (Benjamin Code),

- le second un spécialiste en IA qui n’a jamais codé un site web,

- le troisième a fait une école de commerce mais n’a jamais codé de sa vie.

Pour cette épreuve, les trois ont accès à l’IA de leur choix.

Les trois arriveront au bout du challenge (oui, même celui qui n’a jamais codé). Mais ce qui ressort de ce test, c’est que l’IA est surtout forte pour démarrer un projet. Ensuite, à mesure qu’on ajoute des features, c’est de plus en plus laborieux, à tel point que le non codeur a du finir par essayer de comprendre son code (et donc commencer à apprendre à coder).

▶️ Micode a demandé à trois candidats de créer un QCM en 2 heures avec l’IA de leur choix

6.2- Un développeur junior doit-il utiliser de l’IA ?

Melvynx déconstruit le mythe selon lequel les débutants devraient éviter l’intelligence artificielle. Il explique les raisons pour lesquelles cette croyance est erronée, à condition d’utiliser l’IA de manière intelligente.

Néanmoins, Mike Codeur ajoute qu’un dev junior ou débutant doit utiliser les IA d’une manière différente d’un dev senior, par exemple à l’aide des custom instructions dans ChatGPT :

« Tu es mon mentor, mon professeur, ne me donne pas la solution directement. Fais moi des explications qui me permettent de comprendre comment on arrive au résultat »

▶️ Mike Codeur • Comment apprendre à coder en partant de zéro ?

L’IA est souvent accusée de nous abêtir ou, au contraire, de nous aider à être plus intelligents. Comme souvent, les choses sont plus complexes : fonctionnement des zones du cerveau à l’appui, découvrez quels usages rendent stupides et quels usages rendent intelligents :

6.3- L’IA, un outil de productivité dans le métier de développeur

« L’IA ne prendra pas votre travail. C’est quelqu’un qui utilise l’IA qui prendra votre travail. »

▶️ Business Insider • La classe moyenne des travailleurs du savoir sera confrontée à son propre moment Uber

Si vous vous inquiétez de ce que l’IA signifie pour votre travail, la meilleure défense est d’ apprendre à utiliser l’IA à votre avantage.

Code Concept va dans le même sens :

Les développeurs qui savent se servir des IA remplaceront les développeurs qui ne savent pas se servir des IA

▶️ Code Concept • Non-développeur + ChatGPT = réel danger pour les « vrais » développeurs ?

Incontournable

Je crois que c’est clair, il fallait absolument que je m’y frotte moi-même, sans me contenter des retours des Youtubers dev !

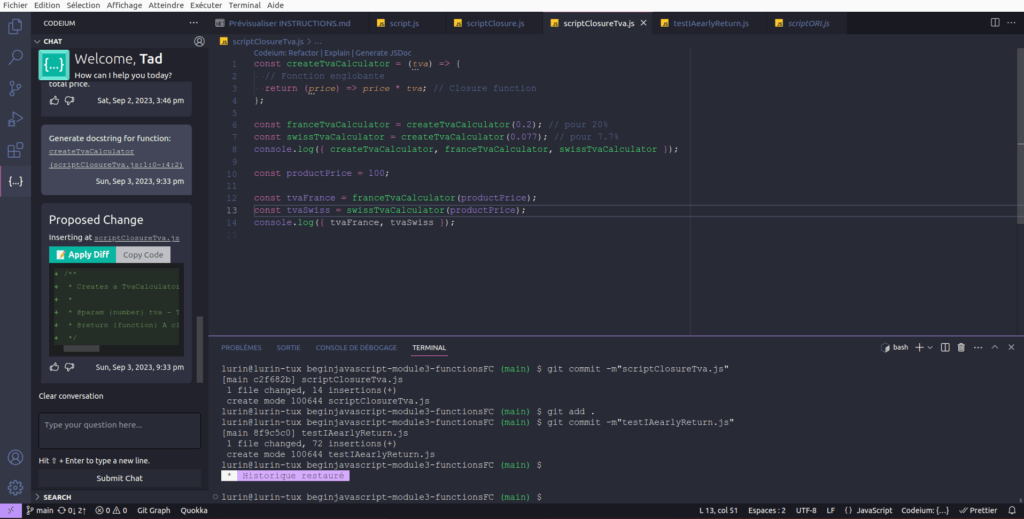

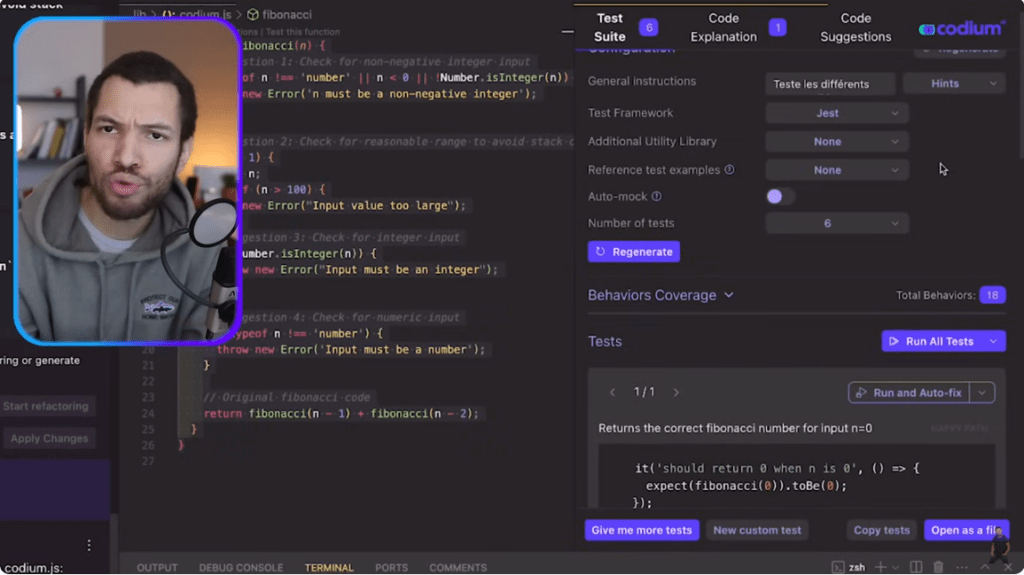

L’écueil est que GPT4, tout comme Copilot ou Cody, sont payants. Mais pouvais-je me contenter du chatGPT3 gratuit, de Bing dans Edge ou de Bard dans Google? Pour mon usage personnel et apprivoiser une IA de code, j’ai finalement décidé de tester Codeium, basé sur GPT, mais gratuit. A ne pas confondre avec Codium, gratuit aussi, et que j’ai également envie de tester.

Encore des tests

A l’usage, je pense que l’IA est un outil de plus qui s’ajoute à la panoplie déjà bien garnie des facilités qu’offrent les IDE : emmet, snipets, intellisense, terminal intégré, extensions diverses, etc.

Autre série de tests :

Une hype qui change sans arrêt

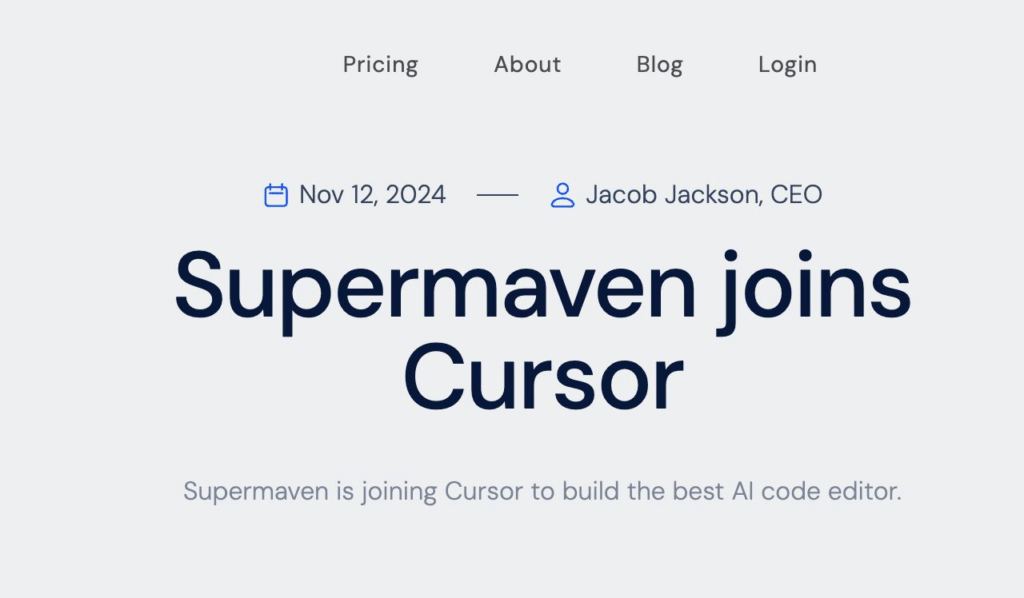

Un an après ces tests qui mettaient Copilot en tête, celui-ci n’a plus la cote chez les développeurs. Le meilleur combo de cette fin 2024, c’est Cursor tournant sous Claude Sonnet, associés à Supermaven.

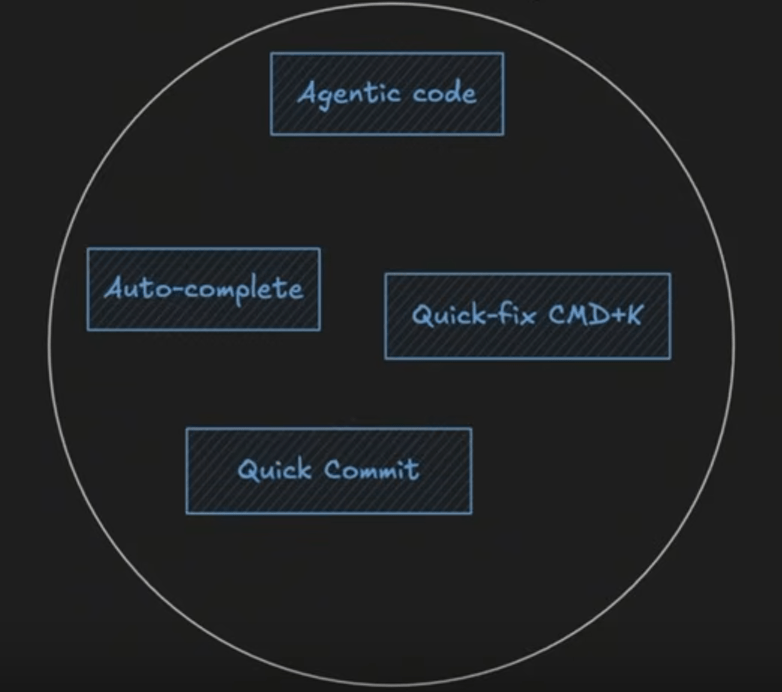

- L’IDE Cursor se concentre sur le DX (Developper eXperience = l’expérience utilisateur du développeur)

- Claude Sonnet d’Anthropic est le meilleur modèle pour le code

- Supermaven est la meilleure extension pour l’auto-complétion.

… Jusqu’à une prochaine fois où d’autres outils seront sortis, d’autres associations se seront faites.

Actuellement on entend par exemple que Copilot, partenaire historique d’OpenAI, veut se rapprocher d’Anthropic, tandis que Supermaven rejoint Cursor. L’IA est décidément un monde en mouvement permanent.

</EDIT>

6.4- La variété des usages des IA par les codeurs

Au fil des articles sur le sujet, j’ai glané ça et là quelques exemples d’utilisation de chatGPT par des codeurs. Une liste qui est appelée à s’allonger avec le temps… J’ai déjà trouvé un article qui recense plus de 50 invites ChatGPT pour les développeurs Web !

![]() Génération de code

Génération de code![]() Complétion de code

Complétion de code![]() Optimisation de code

Optimisation de code![]() Conversion de code

Conversion de code![]() Explication de code

Explication de code![]() Revue de code

Revue de code![]() Refactor de code

Refactor de code![]() Écrire nos commits et pull requests

Écrire nos commits et pull requests![]() Détection et correction des bugs et erreurs

Détection et correction des bugs et erreurs![]() Conception et architecture du système

Conception et architecture du système![]() Optimisation pour les moteurs de recherche (SEO)

Optimisation pour les moteurs de recherche (SEO)![]() Génération de données fictives. Donnez lui un objet en json et il vous générera des variations

Génération de données fictives. Donnez lui un objet en json et il vous générera des variations![]() Écrire des batteries de tests unitaires. Si chatGPT n’y arrive pas, c’est que vous devez refactorer

Écrire des batteries de tests unitaires. Si chatGPT n’y arrive pas, c’est que vous devez refactorer![]() Documentation et commentaires

Documentation et commentaires![]() Commandes du shell et de GIT

Commandes du shell et de GIT![]() Expressions régulières (regex)

Expressions régulières (regex)![]() Génération de contenu

Génération de contenu![]() CV et lettres de motivation

CV et lettres de motivation![]() Préparation à l’entretien

Préparation à l’entretien![]() Apprentissage

Apprentissage![]() Intégrer de l’IA à nos propres applis (API ChatGPT)

Intégrer de l’IA à nos propres applis (API ChatGPT)

« Yapuka » tester tout ça !

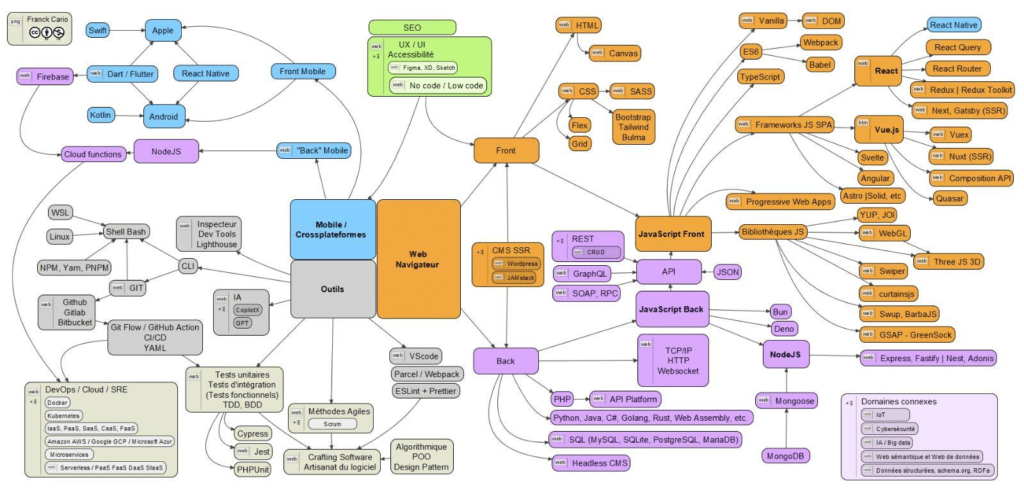

Pour le coup, j’ai mis à jour ma Mindmap Technos (ajout de Copilot et GPT dans les outils)

6.5- Cursor, l’IDE orienté IA

Cursor est un fork de VS Code, orienté IA. On peut presque tout réaliser avec des prompts, quasiment sans mettre le nez dans le code, comme dans la démo ci-dessous. C’est limite flippant.

6.5.1- L’effet Wahou de Cursor

▶️ Melvynx • J’arrête d’utiliser VSCode, voici ce qui le remplace : Cursor (24 min – 2024)

▶️ Melvynx • Un ingénieur AI découvre Cursor, il est choqué (38 min – 2024)

▶️ Ben BK Tech • J’ai créé un logiciel en Python avec Cursor en 5 minutes, sans aucune connaissance en Python (7 min – 2024)

▶️ Ben BK Tech • 12 Astuces Cursor pour devenir le meilleur codeur (7 min – 2024)

▶️ Korben • Coder quand on ne sait pas coder avec Cursor (25 min – juin 2023)

▶️ Hardisk TV • Ces IA savent programmer ! (27 min – 2024)

6.5.2- Travailler concrètement avec Cursor

▶️ Grafikart • Découverte de Cursor, un éditeur basé sur l’IA ( vidéo 19 min | article )

▶️ Melvynx • Configure Cursor comme ça ou juste arrête de coder ! (17 min – 2024)

▶️ Melvynx • Cursor me rend plus productif : voici mes méthodes

Les prix de Cursor (oui, car pour avoir toutes les fonctionnalités, il faut payer un abonnement) : Pricing Cursor

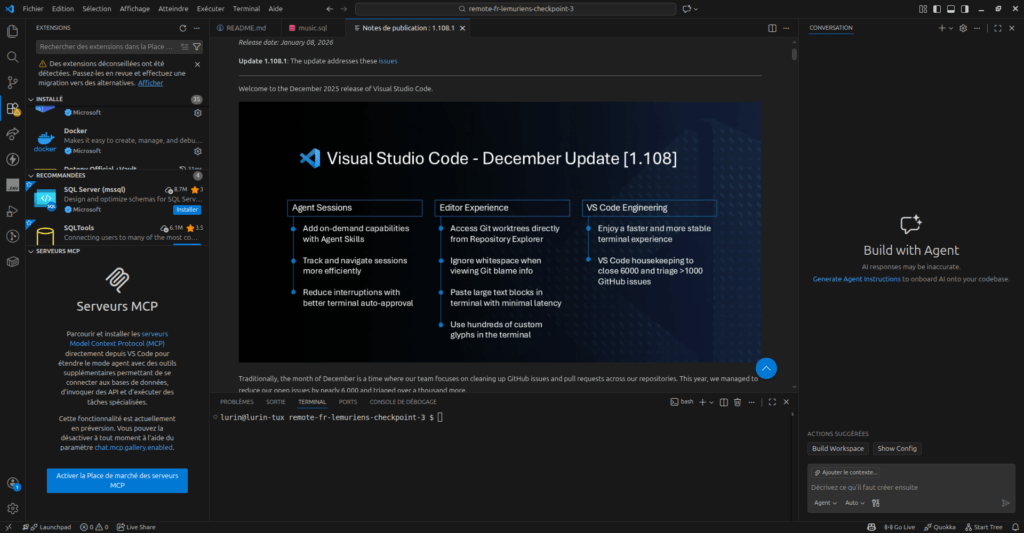

6.5.3- Les Cursor-like dérivés de VS Code se multiplient

6.5.4- VS Code reprend des fonctionnalités de Cursor

Quand c’est l’original qui copie le fork !

▶️ Melvynx • La remontada de VSCode ? Ils ont copié Cursor (11 min – 2024)

Contrairement à VS Code qui a une exclusivité avec Github Copilot, Cursor peut fonctionner avec différents modèles de genAI, dont Claude Sonnet, le meilleur modèle pour le code actuellement.

</EDIT>

6.6- D’autres outils prometteurs

… Ou inquiétants, selon le point de vue !

6.6.1- V0 de Vercel

Dans le même ordre d’idée qu’avec Cursor, Vercel (le créateur de Next.js) propose V0, un outil de génération de code par prompts, basé sur l’IA, et spécialisé sur les composants UI courants du front end : boutons, menus, etc.

Pourquoi v0 : parce que cette IA vous aide à passer d’une page blanche (v0) à votre v1 plus rapidement

V0 de Vercel est un midjourney des interfaces graphiques. Ainsi, au lieu d’un unique gros prompt, vous pouvez faire des prompts itératifs.

▶️ Code Concept • V0 de Vercel : l’IA qui créé vos interfaces graphiques et les modifie comme vous le souhaitez (7 min)

Est-ce que ça vaut le coup ?

Le point positif, c’est qu’on peut reprendre les travaux des autres et les modifier. En voyant les prompts des autres, on se rend compte qu’il faut utiliser du vocabulaire de développeur : « ajoute une div », « mets un plus grand margin », etc. Sachant que derrière, c’est du TailwindCSS. Si on est un cador en CSS, il peut-être plus rapide de peaufiner directement plutôt que de multiplier les prompts. Ça peut néanmoins faire une bonne base de départ, et donc de passer d’une page blanche (V0) à une V1.

Le gros bémol, c’est qu’il n’y a pas d’interactivité. On peut désigner une super card, mais les boutons ne mènent nulle part. On peut designer une super horloge, mais elle ne se mettra pas à l’heure. C’est juste de l’interface. Il y a donc un gros travail à prévoir en plus après avoir copié-collé le code dans son projet.

Et bien entendu, comme tous les outils genAI, il devient rapidement indispensable de passer à une version payante.

6.6.2- Bolt par StackBlitz

Bolt.new est proposé par StackBlitz, le célèbre éditeur de code en ligne. Cet outil ne se contente pas de composants UI, mais est capable de générer des applications entières. En outre, le code est accessible, ce qui permet de combiner prompts et code.

Bolt en ligne

De même que pour Cursor, de nombreux youtubeurs se sont fait l’écho de Bolt, et ils sont unanimes sur ses possibilités :

▶️ Code Concept • StackBlitz Bolt : l’ I.A. qui code, installe des packages et déploie le résultat elle-même ! (16 min)

▶️ Ludo Salenne • Je crée 3 Apps en 15 min avec l’IA Bolt et ChatGPT (sans coder) (17 min)

▶️ Arthur Villecourt • J’ai créé 2 SaaS et 1 site en 2h grâce à cette IA! (je ne suis pas dev) (15 min)

▶️ ABA chaine secondaire d’Arthur Villecourt • Cette IA a Développé Mon Site Web en 45 Minutes (incroyable) (49 min)

▶️ ABA chaine secondaire d’Arthur Villecourt • Bolt.new : comment mettre son site en ligne ( + base de donnée) (11 min)

▶️ Entreprendre – Voyager – Réussir • Cette IA crée une application complète en quelques minutes – Bolt.new (10 min)

▶️ Labo Des Réseaux • Bolt new : créer des applications avec l’IA (sans savoir coder ?) (10 min)

En résumé

Pour l’instant, Bolt ne gère pas le back et peut-être mal à l’aise avec les bases de données. D’ailleurs, il déploie vos app avec Netlify, qui ne gère pas non plus le back. Il faut donc utiliser une API existante et/ou des services tels que Firebase en complément. Il est aussi nécessaire de repasser derrière pour vérifier le code, en particulier en termes de sécurité. Par exemple, Bolt ne se soucie pas de camoufler vos clés API, qui peuvent donc être utilisées par n’importe qui.

Autre désavantage, à mesure que le projet grossit, Bolt a tendance à tout recoder ce qui pose deux problèmes :

- Il introduit des bugs sur des parties qui fonctionnaient

- La consommation en tokens s’envole et la facture avec

Bolt en local

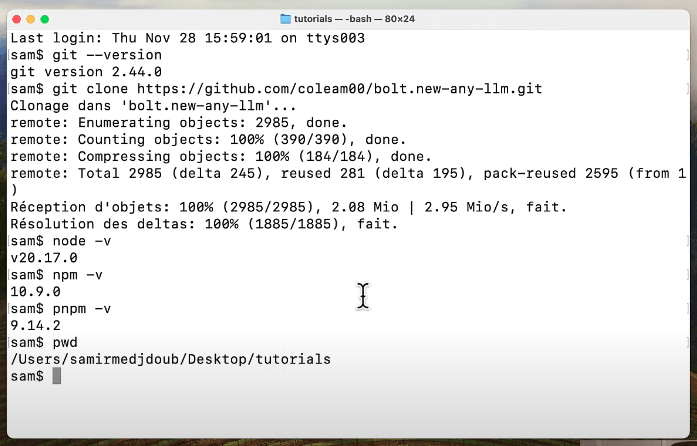

Bolt étant open source, il peut aussi être installé gratuitement en local. Contrairement à la version en ligne, on peut choir les modèles LLM de notre choix, y compris des LLM locaux eux-même, en entrant leur clé API dans le fichier .env (à renommer en .env.local ).

▶️ Code Concept • Voici comment utiliser gratuitement Bolt avec l’I.A. de votre choix (9 min)

▶️ No code skills • Marre de payer une fortune Bolt.new ? Installe-le en local (tuto) (11 min)

▶️ FEU • Bolt : Un outil IA de code sans coder + Alternative gratuite (15 min)

▶️ Le Github du projet : https://github.com/stackblitz/bolt.new

A noter que Bolt étant également utilisé par des non-codeurs, ceux-ci risquent d’être un peu déroutés par GIT et Node.js, indispensables pour une utilisation de Bolt en local :

Le deuxième désavantage est l’extrême lenteur. Il faut en effet disposer d’une bête de course… qui sera tout de même plus lente qu’un serveur : quelque dizaines de token par minute vs plusieurs centaines. A voir si à l’avenir, les puces NPU, pourraient atténuer le problème.

Le futur de Bolt

Enfin, des clones de Bolt commencent à apparaître, tels que Lovable.dev ou Replit.

▶️ ABA • 3 bonnes alternatives à Bolt (que vous ne connaissez pas) (10 min)

▶️ Digitiz • J’ai testé un outil qui surpasse Bolt.new — Lovable est une pépite (10 min)

Cependant, Bolt va certainement s’améliorer, et les développeurs front-end risquent d’être sérieusement concurrencés par cet outil ou un similaire, à plus ou moins long terme. Les front-end exclusifs ont intérêt à s’intéresser rapidement au back-end.

▶️ Mike Codeur • Comment l’IA va Remplacer les Développeurs FrontEnd ? (20min)

▶️ Mike Codeur • Pourquoi React + FireBase n’est pas du Développement FullStack ? (15min)

</EDIT>

6.7- Le métier de développeur va-t-il disparaître ?

A long terme, peut-être. Mais dans l’intervalle, il va surtout évoluer, comme on l’a vu ci-dessus avec l’IA utilisée comme outil de productivité.

Certains oiseaux de mauvais augure vont plus loin en affirmant que le métier de codeur va disparaître au profit de celui de programmeur :

La programmation est le processus de résolution de problèmes à l’aide d’un ordinateur. L’écriture de code n’est qu’un aspect de ce processus. C’est une partie nécessaire, mais ce n’est pas tout. […] Les programmeurs du futur seront bien plus productifs que les programmeurs d’aujourd’hui, capables de prouesses dont nous ne pouvons que rêver.

▶️ Medium • Coding Won’t Exist In 5 Years. This Is Why

6.7.1- Intégrer de l’IA dans les applications qu’on créé pour autrui

6.7.2- Utiliser l’IA dans ses propres pratiques de développeur

La plupart des grands acteurs de l’IA proposent leur assistant de développement IA :

- Cursor (Anysphere),

- Claude Code (Anthropic),

- GitHub Copilot (Microsoft),

- mais aussi Gemini CLI (Google),

- Codex (Open AI),

- Windsurf (anciennement Codeium, convoité par Open AI, déplumé par Google, racheté par Cognition),

- Q Developer (Amazon),

- Mistral Code,

- Code Llama (Meta),

- DeepSeek Coder,

- Code CLI Qwen (Alibaba)…

Les choses évoluent tellement vite avec l’IA, qu’une nouvelle fatigue du développeur est apparue. De même que de nouveaux frameworks JS sortaient d’un jour sur l’autre, de nouveaux outils impliquant de nouveaux workflow apparaissent en IA, à une fréquence élevée. Comment arriver à suivre ? Comment ne pas se perdre dans la hype et se focaliser sur ce qui est vraiment utile ?

▶️ Ramzi ₿ • Je n’arrive plus à suivre ! Je suis dépassé par l’IA.

▶️ DevAr • Tous les devs sont fatigués (et ce n’est que le début) (9 min)

▶️ Benjamin Code Plus • Claude Code détesté par les devs du jour au lendemain (10 min)

Apprendre à utiliser l’IA à bon escient pour ne pas perdre ses compétences

L’IA est souvent accusée de nous abêtir ou, au contraire, de nous aider à être plus intelligents. Comme souvent, les choses sont plus complexes : fonctionnement des zones du cerveau à l’appui, découvrez quels usages rendent stupides et quels usages rendent intelligents :

6.7.3- Faire mieux qu’un pisseur de code

Un développeur n’est pas qu’un pisseur de code. Il doit savoir :

- Définir son code

- Utiliser des méthodologies

- Appliquer des process

- Définir des architectures

- Designer son application

- Automatiser son code

- Automatiser les tests

- Déployer automatiquement

Le tout en utilisant au mieux les capacités des outils IA (prompts, contexte cursor rules / claude.md, RAG, MCP, agents…).

</EDIT>

▶️ Javascript Academy • Pourquoi tu seras toujours un mauvais développeur (Youtube short)

▶️ Artisan Développeur • Recruter Un Pisseur De Code (6 min)

▶️ Grafikart • Non ! l’IA ne remplacera pas les développeurs ! (16 min)

6.8- Un bilan après un an et demi d’utilisation des IA pour le code

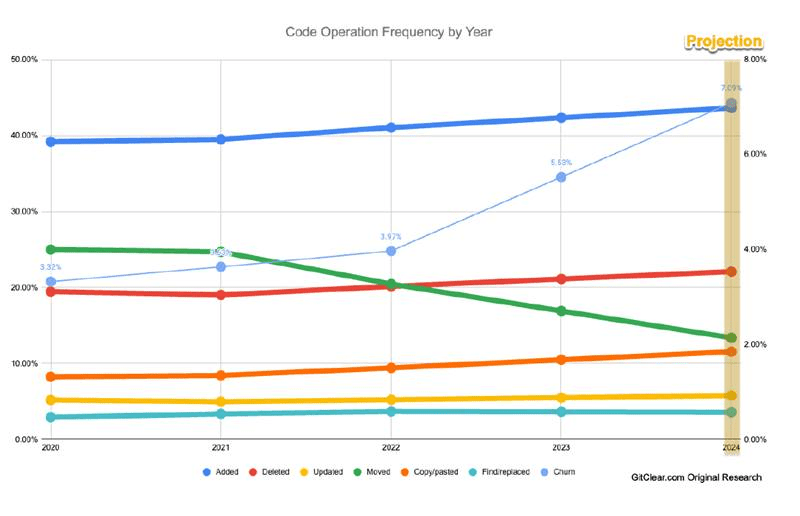

Une nouvelle étude publiée par la société d’analyse GitClear rapporte que l’utilisation des assistants d’IA pour la programmation ne contribue pas toujours à la qualité du code produit. Les chercheurs de GitClear ont constaté que les outils d’IA comme GitHub Copilot ne donnent en fait que des suggestions pour ajouter du code. Aucune suggestion n’est faite pour la mise à jour ou la suppression de code. Il en résulte notamment une quantité importante de code redondant. Ils ont également constaté une forte augmentation du « code churn« . Cela signifie que le code est fréquemment modifié, ce qui est généralement un mauvais signe pour la qualité.

D’autre part, Snyk met en garde sur le fait que Copilot et d’autres assistants de codage alimentés par l’IA peuvent reproduire des vulnérabilités de sécurité déjà présentes dans la base de code de l’utilisateur.

L’utilisation de l’assistant d’IA GitHub Copilot entraîne une baisse de la qualité globale du code et une baisse de la sécurité, voila qui est inattendu !

</EDIT>

Quel est votre avis sur les IA génératives comme Midjourney, chatGPT ou Copilot ? Opportunité ou danger? N’hésitez pas à partager votre point de vue dans les commentaires !

Aller plus loin

a) Fonctionnement technique des IA génératives

- Glossaire de l’intelligence artificielle – CNIL

- Ce qui se cache derrière le fonctionnement de ChatGPT – Vidéo / article – ScienceEtonnante

- J’ai essayé de recoder ChatGPT. Voilà ce que j’ai appris… – Cocadmin

- Comment ces IA inventent-elles des images ?- Vidéo / article – ScienceEtonnante

- Comprendre comment fonctionne un LLM en 5 minutes – Journal du Net

- Comment a-t-on créé ChatGPT ? – L’Esprit Sorcier

- La face (très) sombre de ChatGPT… – Defend Intelligence

- ChatGPT : la face obscure – Kodaps

b) Conséquences économiques des IA génératives

- Gains de productivité, un exemple sans IA, avec Excel – Dimby Rakotomalala

- La classe moyenne des travailleurs du savoir sera confrontée à son propre moment Uber – Matt Turner

- L’emploi est-il la variable d’ajustement de l’automatisation ? – Zdnet

- L’intelligence artificielle va-t-elle nous piquer nos jobs ou juste les transformer ? – Mediaculture

- Comment l’IA transformera le qui et le comment de la programmation – John Graham-Cumming

- La fin du codage tel que nous le connaissons – Aki Ito

- IA génératives : opportunité ou menace pour nos métiers ? – Wild Code School

- Être dev’ à l’ère de l’IA : qu’est-ce qui va changer et comment s’y préparer ? – Talent.io

- Virés par l’Intelligence Artificielle : c’est l’IA qui cache la forêt ! – Toscin

- 82 % des entreprises comptent interdire ChatGPT à leurs employés – Archimag

- 10 métiers que l’IA va remplacer – AI Explorer

- Les IAs des futurs youtubeurs – Dirty Biology

- ChatGPT en entreprise : comment éviter la fuite de données sensibles ? – Journal du Net

- Vous ne devez rien confier à ChatGPT, Google Bard ou Bing – Frandroid

- Compétences IA : les surprenants enseignements de LinkedIn – Journal du Net

c) Intelligences artificielles et éthique

- L’intelligence artificielle n’existe pas, par Luc Julia – France Université Numérique

- L’IA générative va entraîner des considérations juridiques nouvelles sur le droit d’auteur – L’Usine Digitale

- La Chine sous l’emprise de l’intelligence artificielle – France 24

- ChatGPT vient de devenir dangereux – Underscore_

- L’intelligence artificielle fait peur, surtout à ceux qui ne font pas l’effort de la comprendre – Fred Cavazza

- Sam Altman de retour chez OpenAI : coup de tonnerre dans le monde de l’IA – Tech & Co

- Recommandation sur l’éthique de l’intelligence artificielle – Unesco

- Éthique de l’intelligence artificielle – Unesco

- ChatGPT and Artificial Intelligence in higher education: Quick start guide – Unesco

- ChatGPT – A-t-on encore besoin de penser ? – RTBF

- Tech&Débat : IA, une vraie révolution ? – Tech & Co

- L’IA expliquée simplement par un expert, Louis Korcsowski – Vidéo / article – Nicolas Georgemel

d) Intelligences artificielles et géopolitique

- Une IA souveraine : quelles alternatives à ChatGPT ? – France Université Numérique

- Europe, Chine, Etats-Unis face au contrôle de l’intelligence artificielle – France Culture

- Vers une guerre froide de l’IA ? Analyse géopolitique complète – Ludo Salenne

- WeChat : Comment la Chine contrôle 1,5 milliard de personnes – Tev Ici Japon

- Alibaba ajoute, à son tour, de l’IA générative à ses services – L’Usine Digitale

- Alibaba dévoile Qwen-VL et Qwen-VL-Chat, deux nouveaux modèles d’IA multimodale open source – L’Usine Digitale

- Baidu lève (un peu) le voile sur Ernie Bot, qui s’inspire de ChatGPT et sera intégré à ses produits – L’Usine Digitale

- Baidu va déployer l’IA conversationnelle dans les domaines de la recherche, du divertissement embarqué et bien plus encore – TechCrunch

- Un modèle d’IA français, gratuit et sans modération, a été lancé – Frandroid

- Que vaut Mistral 7B, le premier modèle du concurrent français d’OpenAI ? – Le Journal du Net

- La start-up française Mistral AI dévoile Mistral 7B, un grand modèle de langage open source – L’Usine Digitale

- Un modèle d’IA français, gratuit et sans modération, a été lancé – Frandroid

- Intelligence artificielle : que fait l’Union européenne ? – Toute l’Europe

e) IA génératives généralistes

- ChatGPT est une arnaque – Le Frère Codeur (à regarder jusqu’au bout)

- Différence de comportement entre ChatGPT 3 VS ChatGPT 4 – Verax Vulgarisation

- Comment intégrer ChatGPT dans votre moteur de recherche préféré ? – Korben

- ChatGPT : Extensions, plugins et add-ons pour utiliser l’intelligence artificielle – Archimag

- GPT-4, Deepl ou Google Traduction… Quel est le meilleur traducteur ? – Le Journal du Net

- IA générative dans le cloud : Microsoft Azure peut-il être rattrapé ? – Le Journal du Net

- On a testé Bard de Google, le concurrent de ChatGPT – Tech & Co

- Auto-GPT : un aperçu des IA du futur – Ludo Salenne

- Claude 2 est le plus gros concurrent de GPT4 – Ludo Salenne

- Claude 2 surpasse ChatGPT – Oumarou Sanda

- Versions Pro : Claude pro vs ChatGPT enterprise – Ludo Salenne

- Claude 2 VS GPT-4 : duel d’IA au sommet – Le Journal du Net

- Dall-e 3 vs Midjourney : quelle est la meilleure IA ? – Ludo Salenne

- 2024 sera dingue ! (GPT-5, Google Gemini, xAI d’Elon Musk, Llama 3 de Facebook…) – Ludo Salenne

- Etude : les 50 outils d’IA générative les plus utilisés en 2023 – BDM

- GPT-4, Claude 2, Llama 2… Une plateforme pour les gouverner tous – Le Journal du Net (https://poe.com/)

f) IA génératives dans des écosystèmes

- Microsoft dévoile le futur de Word, PowerPoint, Teams et Outlook où l’IA travaille à votre place – Frandroid

- Avec Windows 11, Microsoft veut vraiment que vous utilisiez son IA à la ChatGPT – Frandroid

- Windows 11 : les Européens sont privés de Copilot, voici l’astuce pour l’utiliser quand même – Phonandroid

- Activer Copilot sur Windows 11 en France : La procédure simplifiée – Just Geek

- Windows 12 : faudra-t-il payer un abonnement pour utiliser le prochain OS de Microsoft ? – Phonandroid

- ChatGPT va pouvoir nous répondre avec la voix – Tech & Co

- Google SGE : un bouleversement du trafic organique à prévoir ? – Le Journal du Net

- Gemini, la future IA de Google va être dingue ! – Impact IM

- La puissance de Bard avec le côté pratique de Google Assistant, c’est bientôt une réalité – Frandroid

- OK Google ! L’IA Bard enfin intégrée à l’Assistant pour répondre à vos questions – Lebigdata

- Intelligence artificielle : Google Assistant intègre Bard, pour quels changements ? – Clubic

g) IA génératives orientées Code

- L’IA, combien ça coûte ? – Infodobib

- Un éditeur de code construit autour d’une IA ! – Melvynx

- Github Copilot X La révolution est en marche avec GPT-4 – @tutos-front-end :

- Le nouveau Copilot X de GPT-4 est annoncé ! – Melvynx

- GitHub Copilot complètement expliqué – Melvynx

- GitHub Copilot 5 nouvelles features – Melvynx

- Code 1.5x plus vite, avec ce GitHub Copilot gratuit (Codeium) – Alors on dev

- Codeium, alternative gratuite à Github Copilot ? – SimpleTech

- Cody : Une IA qui connaît l’intégralité de votre base de code – Melvynx

- Comparatif des assistants de codage : Tabnine se détache face à GitHub Copilot – Le Journal du Net

- GitHub Copilot, Codeium, AWS CodeWhisperer : quelle IA est la meilleure pour coder? – Melvynx

h) Usages de l’IA en code

- Comment coder avec l’intelligence artificielle – Alex so yes

- Les développeurs doivent-ils avoir peur de GPT5 ? – Underscore_

- Non-développeur + ChatGPT = réel danger pour les « vrais » développeurs ? – Code Concept

- ChatGPT et CSS, la menace pour les dev front ? – Benjamin Code

- Faites écrire vos commits avec ChatGPT – Parfaitement Web

- Utilisation de ChatGPT pour l’automatisation des tests logiciel – All4Test

- ChatGPT spécial développeur: comment augmenter ta productivité de 20x – Fada Academy

- ChatGPT devient mon second cerveau – exemples concrets pour les développeurs – Mike Codeur

- Comment utiliser ChatGPT en francais ? – Comment Coder

- Plus de 50 invites ChatGPT pour les développeurs Web – Vishwas Gopinath

- GitHub Copilot dans Flutter / Article – Driss AS

- V0.dev de Vercel : générer des composants React grâce à l’IA – Kipdev

- v0.dev – Wow ! les dev frontend vont adorer – Melvynx

- Automatiser le rédactionnel de sites : IA + No Code + WordPress – Impact IM (n8n.io)

- WordPress : ces 3 extensions d’IA générative qui changent la donne – Le Journal du Net

i) UX : Proposer de l’IA à ses utilisateurs dans ses propres productions

- J’ai créé une IA surpuissante ! – Underscore_

- Intégrer l’IA à ton App Facilement – Melvynx

- Des quiz se corrigent tout seuls grâce à l’IA – Melvynx

« L’IA générative : coder sans développeurs ? » est un sujet intriguant qui explore les possibilités de la génération de code par l’IA. Il montre comment la technologie évolue pour simplifier des tâches complexes, ce qui pourrait révolutionner le développement de logiciels et le rendre plus accessible à un public plus large.

Retour de ping : Les technos qu'un développeur web devrait connaitre - Infodocbib

Bonjour, merci pour cet article. L’article aborde une thématique passionnante et essentielle pour l’avenir du développement logiciel. En tant que professionnel travaillant dans le domaine de la digitalisation et de la virtualisation univirtual, je trouve cette exploration des IA génératives particulièrement pertinente.Les intelligences artificielles génératives ont le potentiel de transformer profondément notre manière de concevoir et de développer des logiciels. En automatisant le processus de codage, elles permettent de réduire la dépendance aux développeurs humains, tout en accélérant les cycles de développement. Cette avancée est cruciale dans le cadre de la transformation digitale univirtual des entreprises, où la rapidité et l’efficacité sont devenues des facteurs déterminants pour rester compétitif. La virtualisation, quant à elle, joue un rôle clé en optimisant l’utilisation des ressources informatiques. Elle permet de créer des environnements de développement flexibles et évolutifs, essentiels pour tirer parti des IA génératives. Grâce à la virtualisation https://www.univirtual.ch/fr/business-core/virtualisation-telecommunication , les entreprises peuvent tester et déployer de nouvelles solutions plus rapidement, ce qui améliore leur capacité d’innovation et leur réactivité face aux évolutions du marché.Je voudrais aussi parler de la digitalisation univirtual, qui consiste à intégrer les technologies numériques dans tous les aspects de l’entreprise, est le moteur de cette transformation. Les IA génératives représentent une avancée majeure dans ce processus, en automatisant des tâches complexes et en libérant les ressources humaines pour se concentrer sur des activités à plus forte valeur ajoutée. Cela permet aux entreprises de devenir plus agiles et de se focaliser sur l’innovation et la stratégi

Retour de ping : Windows 11, un gigantesque spyware